En este artículo el autor Thomas Wiebertneit, explica el uso que puede darse a soluciones como ChatGPT para lograr diseñar experiencias y servicios que cumplan las expectativas de tus clientes.

A continuación, te compartimos una versión del artículo publicado en el sitio especializado MyCustomer:

Aplicación de ChatGPT en la Experiencia de Cliente y el servicio

Ahora que nos encontramos en medio -o esperemos que más cerca del final- de una exageración general provocada por el

ChatGPT de Open AI, ha llegado el momento de reexaminar lo que es posible y lo inaccesible; lo que debería hacerse y lo que no. Es hora de buscar casos de uso empresarial que vayan más allá del bombo publicitario y que puedan vincularse a resultados empresariales reales y generar valor comercial.

Basta con remontarse a Google Bard para poner de relieve la importancia de conocer los puntos fuertes y las limitaciones de la plataforma. En su demo de lanzamiento, el chatbot de inteligencia artificial de Google dio una respuesta errónea, que redujo en más de 100.000 millones de dólares la valoración de Google, en lo que sin duda debe pasar a la historia como la demo más cara de todos los tiempos.

Digo esto sin regodearme. Sin embargo, este incidente demuestra lo mucho que está en juego cuando se trata de grandes modelos lingüísticos (LLM). También demuestra que las empresas deben analizar detenidamente qué problemas pueden resolver de forma significativa con su ayuda. Esto incluye tanto soluciones rápidas como estratégicas.

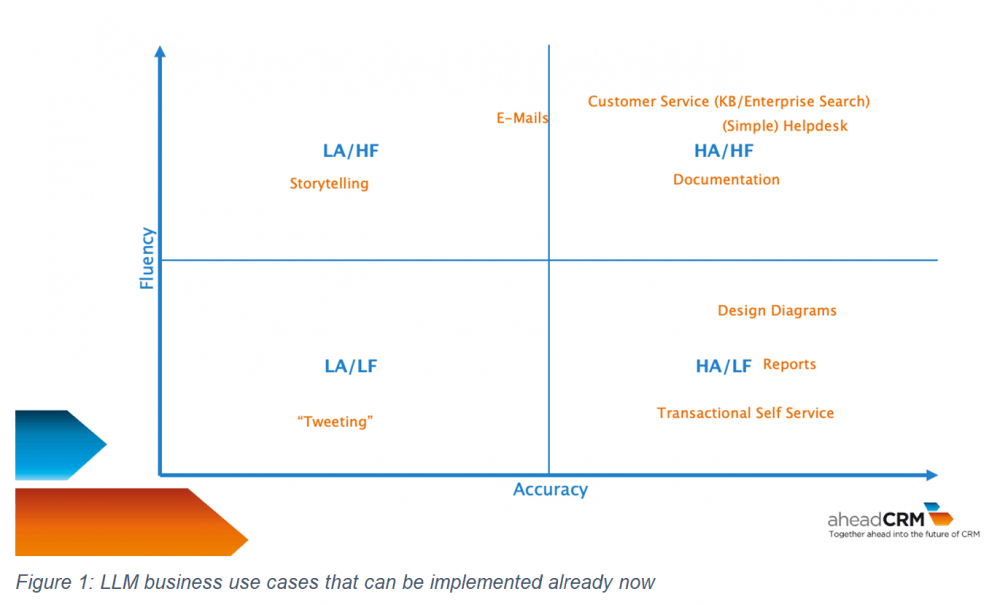

Desde una perspectiva empresarial, hay al menos dos dimensiones que hay que tener en cuenta a la hora de evaluar la utilidad de las soluciones que implican a los LLM.

Una dimensión, por supuesto, es el grado de fluidez lingüística del que es capaz el sistema. Las interfaces de usuario conversacionales, expuestas por

chatbots o bots de voz y asistentes digitales, altavoces inteligentes, etc. existen desde hace tiempo. Estos sistemas son capaces de interpretar la palabra escrita o hablada y responder en consecuencia. Esta respuesta puede ser escrita/hablada o iniciando la acción solicitada.

Una de las principales limitaciones de estos

sistemas de IA conversacional más tradicionales es que son mejores comprendiendo que -a falta de una palabra mejor- expresándose. Al basarse en modelos de aprendizaje automático bien entrenados, también suelen ser capaces de encontrar una solución correcta a los problemas en el ámbito para el que han sido entrenados, ya que suelen trabajar basándose en intenciones preentrenadas.

A partir de los datos de entrenamiento, suelen dar respuestas bastante precisas a preguntas de su dominio. El problema: suelen estar limitados a un número bastante reducido de dominios.

Los programas de aprendizaje automático (LLM), por su parte, suelen entrenarse para "comprender las relaciones entre palabras, frases y oraciones de un idioma. El objetivo es que el LLM genere resultados semánticamente significativos y que reflejen el contexto de la entrada".

Esto es parte de la respuesta de

ChatGPT a la pregunta: ¿Cuál es el propósito de un LLM?. El conjunto de entrenamiento de un LLM suele consistir en una gran cantidad de conocimientos del "mundo real" que suelen proceder de fuentes públicas, es decir, de Internet. El resultado en sí puede estar en formato escrito, gráfico o de otro tipo.

En lo que destacan los LLM es en generar respuestas a preguntas de forma humana. Y pueden responder a una gran variedad de temas. Cuando se centran en texto, están hechos para generar respuestas coherentes y con sentido.

El problema: a veces carecen de precisión y dan respuestas erróneas con total confianza. Y lo que es peor, los resultados erróneos o inexactos no son fácilmente identificables por un usuario sin los conocimientos necesarios.

Véase de nuevo el ejemplo de Google Bard, que hizo desaparecer (temporalmente, al menos) 100.000 millones de dólares de la valoración de Google. Y no se trata sólo de Google; hay muchos ejemplos que señalan a ChatGPT o You.com, entre otras herramientas.

¿Hasta qué punto son precisos los LLM como ChatGPT?

La cuestión es si ambas dimensiones importan siempre por igual o no. En un sentido empresarial, se puede argumentar que la precisión siempre importa. Recibir errores factuales en una conversación comercial no sólo es un ejemplo de mala experiencia del cliente, sino que en casos extremos puede incluso dar lugar a problemas legales.

Lo que también es importante entender es que cuanta más precisión se requiere, más aumenta la necesidad de integrar sistemas adicionales para aumentar el LLM.

Un LLM por sí solo no es mucho más que una forma de entretenimiento. Incluso en los motores de búsqueda, los LLM sólo aumentan la búsqueda al permitir consultas en lenguaje natural y la entrega de resultados en lenguaje humano en lugar de una mera lista de enlaces.

Al menos, esto es lo que deberían hacer.

Dicho esto, ¿Cuáles son los casos de uso empresarial de un LLM? Como ya se ha dicho, se necesita una precisión razonable. Obviamente, también requieren fluidez como condición previa, ya que la fluidez es el diferenciador central de un LLM.

Veamos algunos casos de uso sin ningún orden de prioridad en particular.

Ejemplos de casos de uso empresarial de ChatGPT

Contar historias

Yo empezaría con algo que llamaría "storytelling". Se trata básicamente de la creación de documentos relevantes para el mercado que describen las capacidades y factores diferenciadores de un producto, solución o servicio.

Al estar en cierto modo relacionado con el marketing (sin ánimo de ofender) y ser un primer punto de contacto para los clientes, tiene que ser fácil de entender sin exigir una gran precisión técnica. Al mismo tiempo, no debe ser incorrecto. Una versión simplificada de esto podría ser la generación (mejorada) de contenidos para redes sociales, por ejemplo, tweets.

Los beneficios de esto son una creación más rápida de contenido de alto nivel para sitios web generales, pero también, más específicamente, para escenarios ABM y páginas de aterrizaje. Para poder crear este texto, un LLM necesita estar conectado a sistemas internos que contengan requisitos, especificaciones, así como comunicaciones entre las personas implicadas. Este es también un caso de uso que debería ser implementable a corto plazo.

Correos electrónicos

Una de las principales tareas de las personas es la redacción y, sobre todo, la respuesta a correos electrónicos. Especialmente en los escenarios de ventas, donde las consultas de los clientes pueden formularse y sugerirse basándose en correos electrónicos anteriores y en el contexto proporcionado por el sistema CRM, por ejemplo, sobre las propuestas realizadas.

Este escenario ya requeriría una precisión bastante alta para evitar el envío de información errónea que podría ser legalmente vinculante. La ventaja de este escenario es una reducción significativa del tiempo necesario para enviar correos electrónicos, lo que se traduce en un aumento de la productividad. Es un escenario que Microsoft ya ha implementado en su solución Viva Sales.

Generación de documentos

La generación de documentación es un escenario que varía un poco en el requisito de fluidez. Puede dividirse principalmente en documentación técnica y documentación de usuario. Mientras que la documentación de usuario necesita ser extremadamente legible, el estilo de escritura es algo menos importante para la documentación técnica.

Por el contrario, es probable que la documentación técnica necesite un alto grado de precisión técnica que no es necesario en la documentación de usuario, lo que significa que hay que utilizar diferentes repositorios o diferentes partes de documentos fuente para crear los textos y, potencialmente, diagramas e imágenes.

Atención al cliente

Uno de los casos de uso más prometedores a corto plazo es el servicio de atención al cliente, incluida la búsqueda empresarial.

Aquí, los usuarios quieren respuestas a sus preguntas, no sólo enlaces o algo que se pueda hacer. Para lograrlo, es necesario conectar a una IA conversacional, sistemas empresariales y una base de conocimientos que funcione bien y ayude a generar respuestas precisas cuando se busca algo.

La resolución de problemas es muy similar a lo que ya hacen las IA conversacionales. Las diferencias son que la detección de intenciones puede ser mucho mejor, ya que el LLM puede crear conjuntos de entrenamiento más que suficientes para ello y las respuestas que da el sistema son mucho más fluidas. Lo mismo ocurre en un escenario de consulta.

Sin embargo, como advertencia, la precisión de las respuestas a las consultas depende en gran medida del contenido de la base de conocimientos (KB) que se consulta en la búsqueda empresarial.

Por lo tanto, la base de conocimientos necesita un examen continuo y riguroso. Si se aplica correctamente, los beneficios incluyen una desviación de llamadas mejorada, ya que el sistema puede gestionar más casos, junto con un aumento de la satisfacción del cliente, ya que la gestión de problemas puede resultar bastante fácil y eficiente para el cliente. Cognigy ha presentado recientemente algunos ejemplos muy buenos (aquí y aquí) que también incluyen entrada y salida de voz.

Asistencia al agente

La asistencia al agente es algo más fácil de implementar, ya que en su mayor parte necesita conectarse a la aplicación de atención al cliente, incluido el historial de chat. Por supuesto, también es útil tener acceso completo a los datos de ventas y marketing.

Combinado con un análisis de sentimientos, el LLM puede sugerir bloques de texto para que los utilice el agente. Los beneficios de esto son una mayor eficiencia del agente y, muy posiblemente, también una mayor satisfacción del cliente, ya que los bloques de texto muestran más empatía con la situación del cliente que los textos generados sin un LLM.

Conclusión

En resumen, estos cinco escenarios muestran casos de uso que implican un LLM que van más allá del bombo publicitario. Pueden implementarse en poco tiempo y también pueden vincularse fácilmente a resultados empresariales. De este modo, sus beneficios pueden medirse.

¿Qué otros casos de uso ves? ¿Y cómo los relacionarías con el valor empresarial?

Escrito por WOW! Customer Experience

Escrito por WOW! Customer Experience

Casos de éxito

Casos de éxito

Opinión

Opinión

Noticias

Noticias

Tendencias

Tendencias

Sin categoría

Sin categoría

Estrategia

Estrategia

Service Design

Service Design

Voz del Cliente

Voz del Cliente

Cultura

Cultura

Herramientas

Herramientas